ich hätte gerne ein 3d-modell (stl) eines rechtwinkligen dreiecks mit den kurzen seiten von 12cm und 8cm und einer höhe von 3cm. Das dreieck soll aber nicht ausgefüllt sein, sondern innen eine art gittermuster haben.

Claude antwortete:

Ich erstelle dir das STL-Modell. Lass mich kurz den passenden Skill prüfen und dann das Modell bauen.

Triangulations-Engine fehlt — schnell installieren:

Das STL ist sauber: wasserdicht, korrekte Abmessungen (120 × 80 × 30 mm), ein zusammenhängendes Teil mit 1156 Facetten.

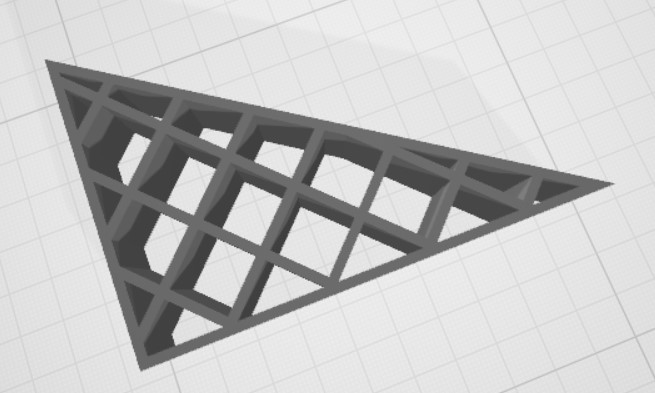

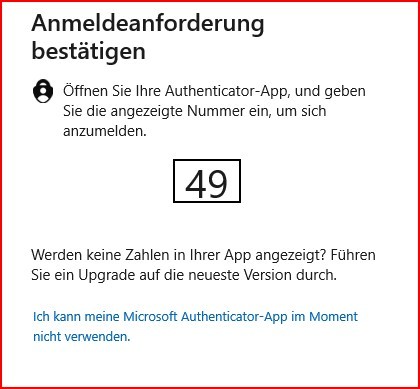

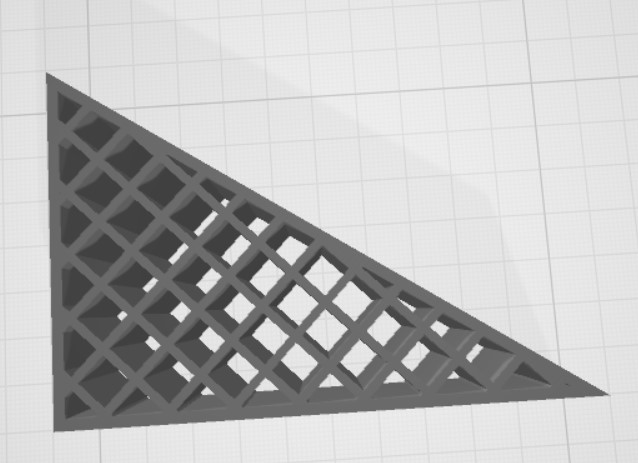

Lass mich noch eine Vorschau rendern, damit du siehst, wie das Gitter aussieht:

So sieht das Modell von oben aus — Außenrahmen mit diagonalem Rautengitter, alles 30 mm in die Höhe extrudiert:

Eckdaten:

Eckdaten:

Da ich mit dem Ergebnis noch nicht zufrieden war, antwortete ich

Eckdaten:

Eckdaten:

- Katheten: 120 × 80 mm, Höhe 30 mm

- Außenrahmen: 2,5 mm stark

- Gitterstege: 2 mm stark, Abstand 14 mm, in 45°-Diagonalen

- Volumen: ~67 cm³ (vs. ~144 cm³ als Vollkörper, also gut 50 % Materialersparnis)

- Wasserdicht (druckbar)

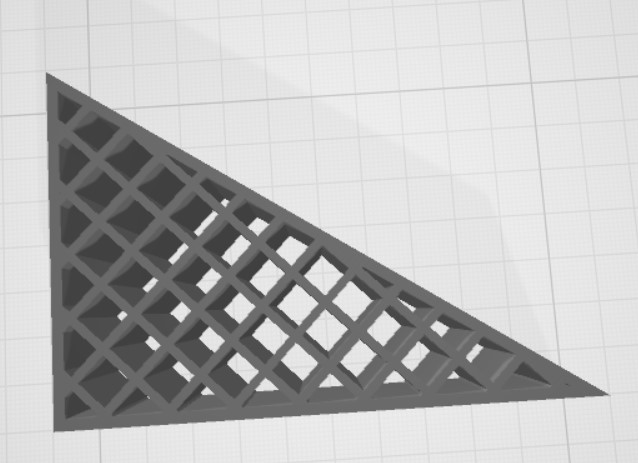

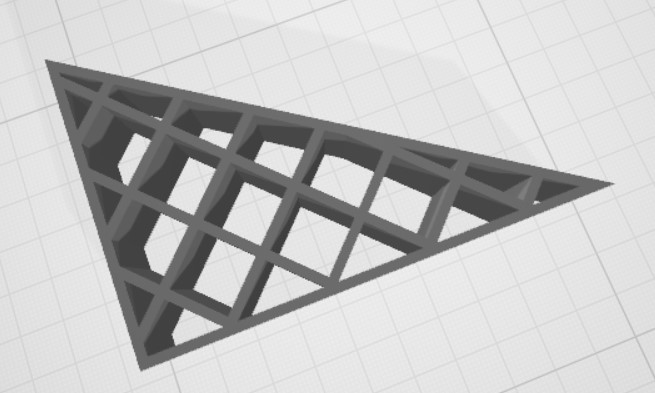

bitte eine version mit gröberem gitter

und Claude tat wie befohlen:

Gröberes Gitter: Zellgröße 25 mm (vorher 14 mm), Stege 2,5 mm. Volumen ~57 cm³, weiterhin wasserdicht.

Erstellen von geometrischen Objekten durch sprachliche Beschreibung - Keine Nutzung einer CAD-Software, kein Kenntnisse von trigonometrischen Funktionen notwendig.

]]>